免费的真相

经济学里有一个古老的原则:天下没有免费的午餐。 如果有人请你吃饭,总有人买单。如果没人为这顿饭付钱,那顿饭就是你。

在AI领域,这个原则不仅成立,还格外隐蔽。

你每天在用的免费AI,比如豆包、ChatGPT免费版、DeepSeek,它们的供应商没有向你收钱。但这些供应商有服务器要维护,有工程师要发工资,有电费要交。

这笔钱从哪来?

有四个来源,每一个都值得你认真对待。

免费模型的四个真实成本

成本一:你的对话数据

免费AI怎么改进模型?需要训练数据。训练数据从哪来?从你和几亿用户的每一次对话中来。

GPT早期就是靠这些数据取得了极大的提升。当然,现在AI产品一般都允许用户取消授权。

你说的话、你传的文件、你点赞或重试的记录……这些都在帮助模型变得更好。你每一次使用免费AI,都在充当它的免费标注员。

这不是阴谋论,这是公开的商业模式。OpenAI的用户协议里明确写了可能使用对话数据改进服务,各家的条款大同小异。如果你用的是免费版,你的数据被用于模型训练的概率远高于付费版。

这是否意味着你不能用免费AI?不是。这意味着:不要在和免费AI的对话里放任何你不想让第三方看到的信息。 公司财务数据、个人医疗记录、未公开的商业计划——这些东西,一般付费版才有数据保护条款,免费版没有。

成本二:模型降智

你用的免费版AI,和它的付费版,一般不是同一个模型。

免费版通常会采用更小的模型、更激进的量化、更低的推理精度。这意味着:

- 同样的Prompt,免费版的输出质量更不稳定

- 复杂任务(长文本分析、多步推理)的退化尤其明显

- 高峰期可能被限流,响应变慢或干脆不可用

更隐蔽的是:很多“AI中转站”在API层面做了降级。 它们从官方渠道批发采购高性能模型的API额度(或使用其他不合规的手段),然后转卖给用户。为了压低成本挤利润,它们可能在传输链路上把用户请求重定向到更便宜的小模型,用户付了“GPT大杯”的钱,实际得到的是“GPT小杯”的输出。

成本三:稳定性无保障

付费服务的SLA(服务等级协议)通常承诺99.5

你正在赶一份明天要交的报告,AI突然因为流量过大返回“服务繁忙”。你没有任何追索权,因为你没有付费。

对于不依赖AI完成关键任务的用户来说,这个成本几乎为零。但对于用AI处理工作流程的用户来说,免费服务的不可靠性本身就是成本,时间成本、机会成本、以及“关键时刻掉链子”带来的信任崩塌。

成本四:安全边界模糊

免费AI产品的安全投入通常低于付费版。这意味着:

- 对话数据存储的安全性可能不足

- 第三方插件和工具的审核可能不严格

- 模型输出的安全过滤可能不够精细

一些小型AI服务商甚至可能直接转卖用户的对话数据给广告商或数据中间商。

这不是“少数黑心商家”的问题。这是免费模式的结构性倾向:当用户不付费时,供应商必须在别处找到收入。数据是唯一可规模化变现的资产。

API中转站的灰色地带

自GPT-3.5问世以来,“AI API中转站”成为了一门生意。2026年,OpenClaw等Agent爆火,中转站成为一个热门赛道。

需要注意的是,这个看起来只是“技术便利”的服务,实际上踩在了多重法律与商业伦理的红线边缘,其暴利的背后是整个AI生态中隐秘而危险的套利链条。

它们的商业模式看起来诱人:把各家大模型厂商的API统一封装,用户不用在各家单独开户付费,一个平台用所有模型,而且价格比官方渠道便宜。

例如,有人打出“1元可兑换285万Token”的广告。按这个价格,和OpenAI的官方API价格对比,差了上百倍。

这个价格是怎么做到的?

一般来说有几种方式:

- 套利补贴。 利用不同渠道的批发价差、或投资人的补贴烧钱抢用户。这种模式不可持续,补贴烧完就涨价或跑路。

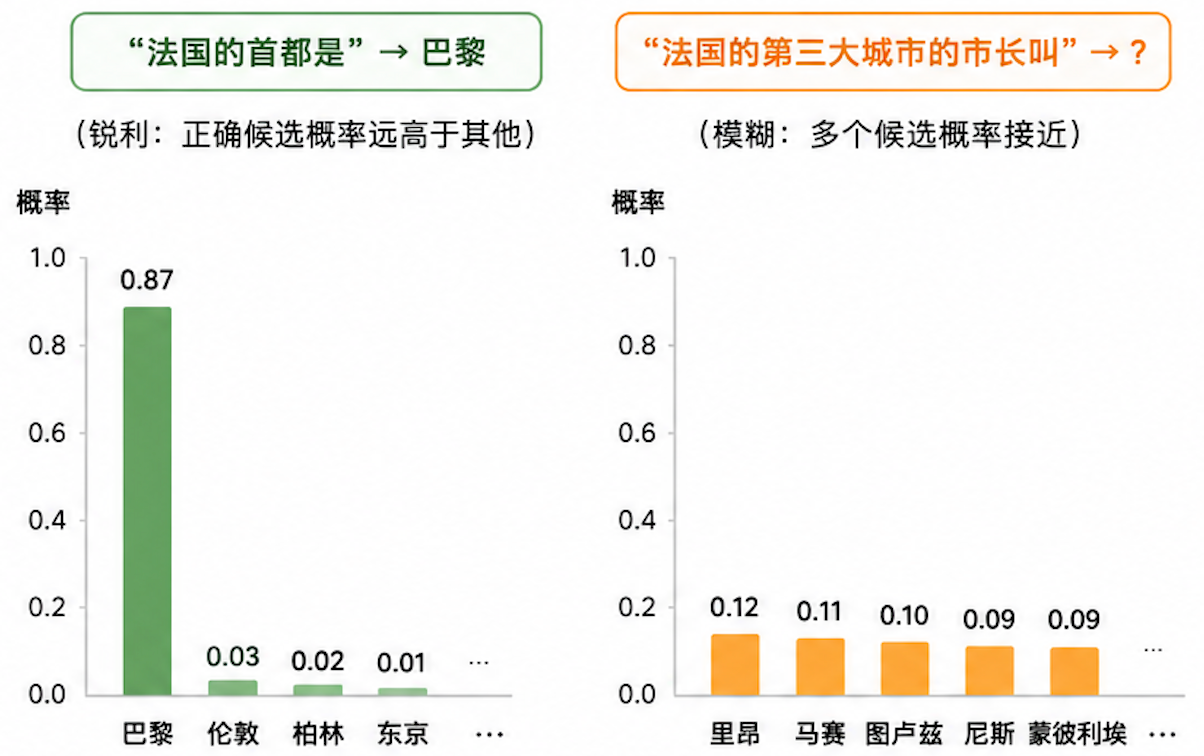

- 模型降级。 用户请求GPT-4o,中转站实际分发给了更便宜的模型(如GPT-4o-mini),用输出相似性掩盖。普通用户很难发现——因为对于简单的问题小模型回答通常“看起来也挺好”。

- 账号共享。 中转站用一批共享付费账号或批量注册免费账号调用官方API,然后分发给多个用户。这违反了几乎全部模型厂商的服务条款,被封号后用户的余额和对话记录一起蒸发。

- 数据窃取。 有安全研究人员实测发现,部分中转站在传输过程中注入恶意代码,窃取用户的云服务凭证和加密资产。

AI中转站不是一个“便宜好用”的银弹。它是一个高风险渠道,不适合承载任何严肃的生产任务或敏感数据。

一个决策框架:什么时候必须付费

不是所有场景都需要付费。也不是所有场景都适合免费。

一个简单的决策框架:

你应该继续用免费的,如果你:

- 只是在日常闲聊、简单问答、偶尔辅助写作

- 处理的内容没有任何敏感信息

- 不依赖AI完成有截止时间的任务

- 愿意接受偶尔的“服务繁忙”和输出质量波动

免费AI的价值是真实的,它让你用零成本体验和探索AI的能力边界。本书前七章讲的大部分原则,你都可以在免费版上练习和实践。

你应该考虑付费的,如果你:

- 在生产环境中使用AI。 你的Agent在替你做决策、处理客户请求、或自动执行操作。稳定性不是“可选项”,是“基本要求”。

- 处理敏感数据。 公司内部文件、客户信息、个人隐私等等,你需要数据处理的合规保障,而免费版不提供这个保障。

- 需要可预期的成本。 免费版的限流和降级可能在你最需要的时候发生。付费版的稳定API让你能规划资源。

- 需要高精度和一致性。 复杂任务、长文本、多步推理等,付费版的高配模型和更大的上下文窗口,产出质量差异显著。

图1:快速判断你适合哪种付费方案

一个实用的过渡策略:先在免费版上验证你的Agent设计,确认它能稳定工作、评估通过。然后切换到付费版的稳定API,作为生产环境的基座。

开源+本地部署:第三条路

除了免费和付费,还有一个正在快速成熟的选项:开源模型 + 本地部署。

2025年,一些开源大模型的能力已经追到和闭源模型非常接近的水平,例如DeepSeek、Qwen、Gemma等系列模型。同时,端侧推理的软硬件生态进展迅速:Apple Silicon的统一内存架构、专用推理引擎的持续优化,让一台MacBook Pro就能运行不错的开源模型。

本地部署的优势:

- 数据不出你的设备。 所有处理在本机完成,不存在“发送到云端”这一步

- 零边际成本。 除了电费和硬件折旧,每次推理不额外花钱

- 不受服务中断影响。 你的Agent不需要依赖任何外部API的可用性

本地部署的劣势:

- 需要硬件投入。 至少16GB(会随着模型发展越来越小)统一内存的设备,加上一定的技术配置

- 模型能力有上限。 本地能跑的模型通常弱于云端最强模型,此外,AI公司还会做一些工程层面的设计

- 需要自己维护。 没有厂商帮你修bug、做安全补丁等

本地部署是隐私敏感场景和数据主权场景的最佳选择。

AI培训班的真相

既然说“天下没有免费的午餐”,那“付费的AI课程”呢?

市场上有大量AI培训:“三天速成AI大师”“零基础转行年薪百万”“工信部认证AI工程师证书”。

这些培训的真实情况是:

- 内容可替代性极高。 绝大部分课程内容,可以在各AI公司的博客、公开文档、以及GitHub上的开源教程中学到。

- 证书含金量极低。 “工信部备案”不意味着“工信部认可”。市场上的AI证书大多是培训公司自己发的,企业招聘时不认。

- 焦虑是他们的产品。 用“AI即将取代你的工作”这句话制造焦虑,然后卖课程缓解焦虑。AI改变的是工作性质,不是摧毁就业。AI公司渲染“替代人力”的故事有其商业动机,即让企业以人力成本为对标来给AI产品定价。

这不是说所有AI课程都是骗局。好的课程确实存在:如吴恩达的系列课程、Datawhale的开源社区教程、各大模型公司的官方workshop。

判断标准很简单:好课程教你理解系统,坏课程卖你焦虑和证书。

本书属于哪一种?

你真正在买的,是什么

付费AI、本地部署、免费试用——归根结底,你买的不是“更强的AI”。

你买的是三样东西:

可靠性。 免费版可能偶尔“惊艳”。付费版的真正价值不是“更惊艳”,而是“更可预测”。你知道它什么时候能用,你知道它的输出在什么范围内波动,你知道出问题时找谁。

自主权。 你的数据归你,你的Agent配置归你,你的使用方式由你决定,而不是由供应商的商业策略决定。自主权在付费版里被部分保护,在本地部署中被完全保留。

时间。 你不会因为“服务繁忙”而中断工作流,你不会因为“模型突然改版”而需要重新调试所有Prompt,你不会因为中转站跑路而丢失配置和数据。

这三样东西,每一项都可以用价格来衡量。但你真正付的,不是模型的智商,而是你能在多大程度上把AI当作一个可靠的系统组件,而不是一个时灵时不灵的聊天玩具。

本章小结

免费AI是一顿免费的午餐。你付出的不是钱:是你的数据、你的稳定性保障、你的安全边界。

这顿饭吃不吃,取决于你用它来做什么。日常聊天和探索,免费是合理的。对于生产环境、敏感数据、关键任务,“免费”二字背后有你看不到的账单。

| 场景 | 推荐 | 理由 |

|---|---|---|

| 日常聊天、简单问答 | 免费版 | 成本为零,风险可接受 |

| Agent原型和实验 | 免费版 | 验证想法,成本低 |

| 生产环境Agent | 付费API | 需要稳定性和可靠性 |

| 敏感数据处理 | 本地部署或付费企业版 | 数据主权和合规 |

| 学AI | 免费课程+官方文档 | 内容质量远胜付费培训班 |

核心原则:

该花的钱,不能省。着急要你钱的,不能花。

自查清单

- 我能说出免费AI的四个真实成本

- 我知道API中转站的风险在哪里

- 我能判断自己的场景该用免费、付费还是本地部署

- 我理解付费买的核心不是“更强的模型”,而是可靠性、自主权和时间

- 我能区分“好AI课程”和“焦虑收割型AI培训”