你被骗了

过去两年,你一定听到过这句话:

“AI已经进入下半场了。”

它的变体包括:“大模型格局已定”“Agent是最后的战场”“2026年是AI应用爆发元年之后就是淘汰赛”……

这些话的共同特点是:听起来很有判断力,实际上没有任何信息量。

说“AI进入下半场”的人,在2023年ChatGPT刚火的时候也在说“AI进入下半场”。在2016年AlphaGo赢李世石的时候也在说“AI进入下半场”。在2012年AlexNet拿下ImageNet冠军的时候也在说。

每一次他们说“下半场”的时候,真正的变化都还没有开始。

不是因为下半场不存在。是因为“上/下半场”这个比喻本身就是错的。

AI不是一场足球赛。它没有固定的90分钟。它更像一栋正在建造的大楼:你看到的永远只是已经盖好的那几层,而看不到地基以下正在打桩的部分。

三个信号:一切才刚刚开始

为什么说AI还没有进入下半场?三个信号。

信号一:基础设施远未定型

今天的Agent开发,还处在“手动搭建”阶段。你需要自己选模型、写Prompt、搭工具链、做校验、跑评价——每一步都有大量手工工作。

对比一下:

- 2006年做网站:你需要手写HTML、配Apache、管服务器,一个月上线几个单页。

- 2026年做网站:你只需要输入需求、Vibe coding、注册一个Vercel账号,十分钟上线相同的内容。

Agent开发的“一键上线”还没有到来,不管是小龙虾(OpenClaw)还是爱马仕(Hermes)都是“简易的玩具”。OpenClaw在冲击操作系统层,Claude Code和Codex在争夺开发者入口,Hermes在尝试持久化记忆和自我改进……未来的Agent开发者会有一个集成的工作台:匹配业务并定义任务 → 自动生成上下文模板 → 自动推荐工具 → 自动搭建评价体系 → 一键部署。

这个工作台现在还不存在。但它在建设中。当它成熟时,今天的“Agent开发专家”的技能将被大幅压缩。

现在学的应该是设计原则,不是工具操作。 工具会变,但原则不会。

信号二:评价体系刚刚起步

我们在第六章讲了评价。但实话实说:整个行业对Agent的评价标准,还处在“凭感觉”的阶段,这两年大火的“具身智能”也是如此。

公开的Agent Benchmark少得可怜。现有的那些和真实场景差距巨大。企业内部的评价体系大多还停留在“PM(产品经理)抽检几个case”。

但过去几十年的软件工程历史告诉我们:当一个领域的评价体系成熟时,这个领域的工程化才真正开始。

测试驱动开发(TDD)在2000年代初被提出,花了十年才成为行业主流。Agent的“TDD时刻”还没有到来。当它来临时,今天“感觉不错就上线”的Agent产品,会被系统化评估打得体无完肤。

现在建立评价能力,是在为那个时刻做准备。

信号三:Agent还没有进入“操作系统层”

今天的Agent,绝大多数还是“应用层”的东西:一个聊天框、一个CLI(命令行工具)、一个接口。

但Agent的终局形态一定不是“又一个App”。是操作系统级的能力。

想象一下:你的电脑不需要你打开“文件管理Agent”来整理文件、打开“日程Agent”来安排会议、打开“搜索Agent”来查资料。这些能力长在操作系统里:像今天的右键菜单和搜索栏一样,无处不在、时刻在线、自动响应。

路径上,当前行业已经形成了两条清晰的路线图。

第一条路径是“自顶向下”:OS巨头亲自下场,把AI Agent塞进操作系统底层。

谷歌正在推动Android从手机操作系统转型为跨设备的智能操作层。2026年,Gemini已正式取代Google Assistant,成为安卓默认的系统级AI,覆盖全球20亿设备。Android 17更进一步,Gemini Intelligence深度集成在系统底层,能够读取屏幕内容、理解模糊指令、跨应用自动完成多步骤任务。微软计划发布Windows 12,将侧边栏AI插件进化为系统级智能体,深度嵌入操作系统的每一处交互逻辑。巨头们正在做同一件事,把Agent从“应用层”拽进“系统层”。

第二条路径是“自底向上”:芯片厂商从硬件层面推动“Agent OS”的落地。

联发科在硬件层面重新定义底层的Agent底座。简单来说,手机不需要你唤醒,它能自己感知场景、主动服务。这条路的难点其实是各国的合规问题。

自顶向下的OS重构,与自底向上的芯片赋能在2026年交汇。 操作系统的形态正在发生根本性变化:AI不再是附加上去的新功能,而是正在变成操作系统新的内核。

但这只是开始,两条路现在都不成熟。

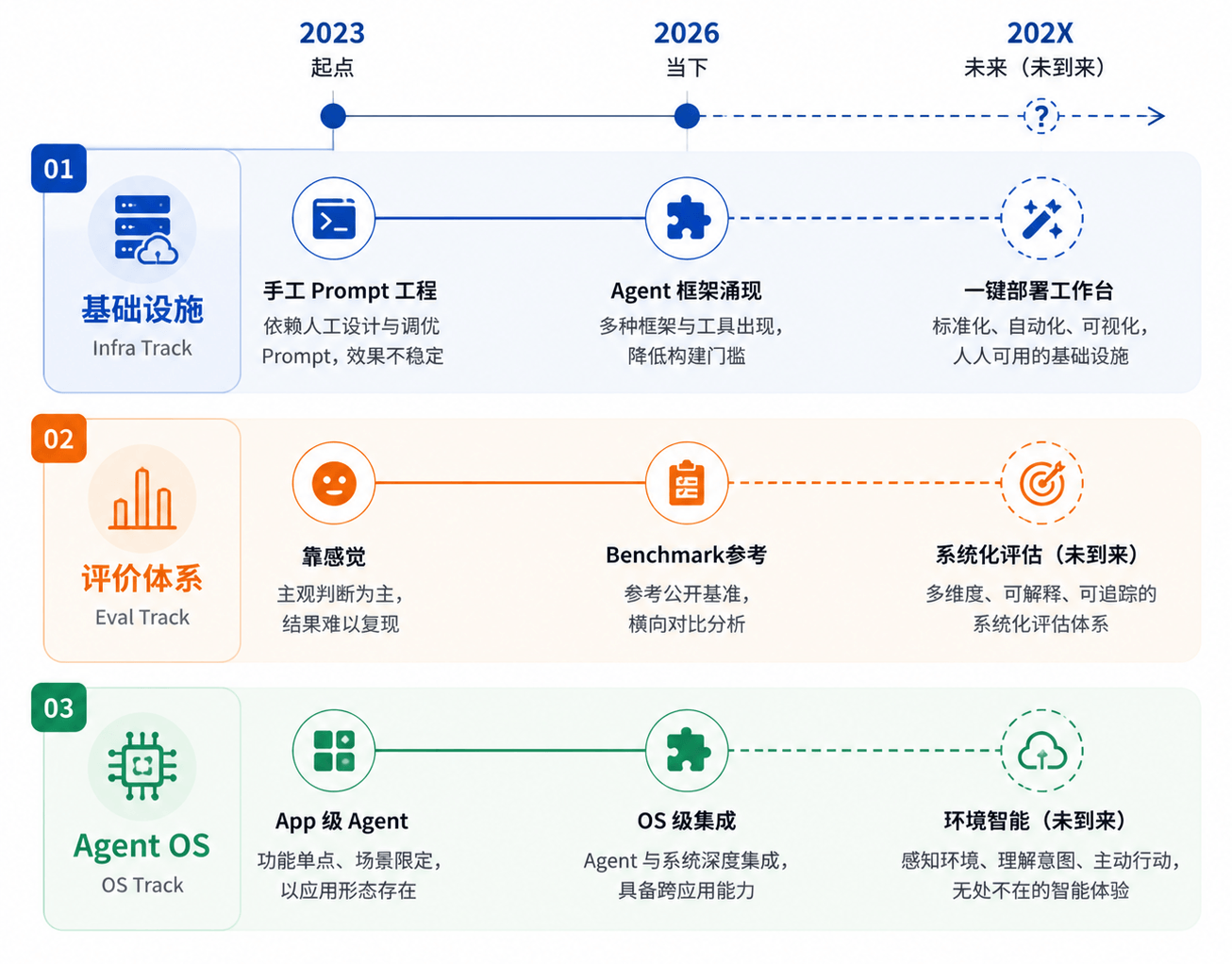

图1:AI Agent发展趋势

你的位置

既然没有进入下半场,那你在哪里?这本书从一开始就给你画了一条线——从“使用者”到“设计者”。现在到了最后,我们把这条线画实。

如果你是一个普通用户

你日常用AI写东西、查资料、做总结。你不需要建Agent系统。

但这本书给你了一件更重要的东西:你不再被聊天框困住了。

你知道AI不是“聪明的人”,是“概率引擎”。你知道Token化让你损失了什么。你知道什么时候该给范例、什么时候该加约束。你知道当你扔一份50页PDF进去时,中间那部分大概率没被“记住”。

这些东西不能让你“用AI月入十万”。但它们能让你:

- 不再被AI编造的数据骗

- 不再纠结“为什么换个说法结果就不同”

- 不再被“万能提示词模板”收割

你的下一步: 在你常用的AI产品里,练习本书前三章的内容。定义任务锚点、控制输入质量、学会在Prompt里说“不知道就说不知道”。当这些变成肌肉记忆,你已经是少数“知道自己不知道什么”的用户了。

如果你是一个创作者或产品经理

你已经在搭Agent、写工作流、调Prompt。

这本书给了你一套诊断框架:Agent不稳了,你能定位到是上下文污染、工具设计缺陷还是评估缺失。你不再“凭感觉调参”。在接触业务时,你知道,根本没有一个完备的“兜底策略”。

如果你是一个开发者

你会写代码。你已经有能力搭Agent系统。

这本书想做的是:帮你从“能搭”升级到“会设计”。

“能搭”:会调用LLM API,会Function Calling,能用LangChain或Dify搭一个workflow。

“会设计”:拿到一个新需求,你能判断这个任务该不该用Agent?该不该拆成多个Agent?每个Agent的边界在哪?评价标准是什么?最可能翻车的地方在哪?

“会设计AI”的人,可能是未来五年最稀缺的人。

最近行业里出现了一个新岗位,Forward Deployed Engineer(前沿部署工程师),专门负责在客户现场部署和集成AI系统。这个岗位的出现,说明了一件事:AI落地最大的瓶颈已经不是模型,而是怎么把它装进真实业务里。

AI发展之快,前所未有,也许一年后,今天的“最新最贵的模型”会变成“便宜实惠的老模型”;Agent开发的工作台工具比今天顺手十倍;操作系统层的Agent开始进入普通用户的设备。

也许几年后,今天你在学的“怎么调Prompt”已经不重要了。模型足够强,Prompt随意写,输出都还行。

但今天你在这本书里学到的另外几样东西:

- 怎么拆解一个任务,让它适合Agent处理

- 怎么设计约束,让AI不能犯某些错误

- 怎么建评价体系,让“好不好用”不是感觉而是数据

- 怎么组织多个Agent,让它们协作而不是互相拖累

这些东西,依然是你最有价值的技能。

因为模型会变强,但系统不会自己设计自己。工具会进化,但判断力和架构感永远是人的优势。

最后

这本书的名字叫《为什么你说话AI不爱听》。

你现在知道答案了:不是AI不爱听,是你一直在用“对人说话”的方式,跟一台概率引擎沟通。

但更重要的是,你已经不需要“让AI爱听”了。

你不是在“和AI对话”。你是在设计一个AI系统。

这个系统包含模型、上下文、工具、约束、校验、评价、恢复机制。它不是你“说话”的对象,它是你设计和迭代的工程系统。

对话能力是起点。设计能力是终点。而大多数人,从来没走出起点。

你已经走出了。

AI还没有进入下半场。你的下半场,也才刚刚开始。

感谢您的阅读。

Howard

2026年5月15日