一个你肯定遇到过的场景

你把一份三十页的行业报告拖进对话框,敲了一行字:

「帮我总结这份报告的核心结论。」

几秒后,AI(人工智能)给你列了三条结论。条理清晰、措辞专业、每一条都有模有样。你很满意。直到——

你随手翻了翻原文,发现其中一条结论在报告里根本不存在。AI 编造了一段逻辑自洽但完全虚构的分析,还煞有介事地标注了“根据报告第X部分”。

你又试了一次。这次,同样的提示词,结论变了一点点:上次编造的那条消失了,但新出现了一个同样不存在的数据引用。你的第一反应八成是:这AI今天不太行。

这个反应本身,就是本书要解决的第一个问题。

搞清楚我们在聊什么

在钻进AI的脑子之前,我们需要花三十秒,认清楚几个词。

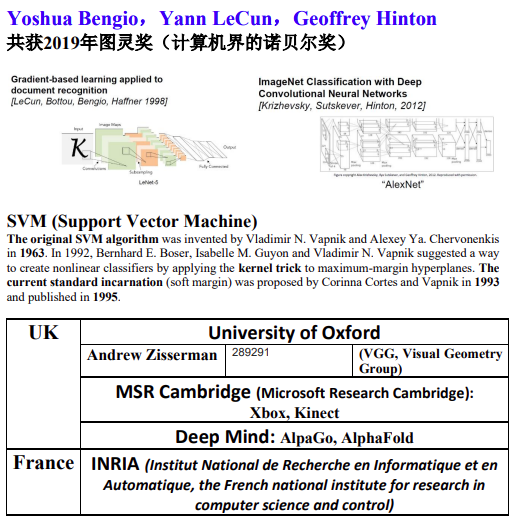

你每天挂在嘴边的“AI”,其实是一个极其宽泛的概念。人脸解锁是AI,导航规划路线是AI,AlphaFold预测蛋白质结构也是AI,这些跟ChatGPT这类对话式产品八竿子打不着,但都叫AI。

这本书要讲的,是AI家族里一个特定的分支。我们一层层缩圈。

生成式AI(GAI或AIGC):AI里“能创作”的那一批。它不只识别和分类,还能生成全新的内容:写一段话、画一张图、谱一首曲子。你手机里的AI生图和AI写文案,都在这层。

语言模型(LM):生成式AI里专门处理文字的那一类。

视觉语言模型(VLM):生成式AI里能处理文字、图片和视频的那一类。

大语言模型(也叫大模型,LLM):语言模型里规模最大的那批。ChatGPT、Claude、豆包、DeepSeek,你叫得出名字的对话式AI,都是大模型。当你把它们装进一个能调用工具、能自主决策的系统里,它就变成了AI Agent(大模型驱动的智能体,有别于宽泛的Agent概念)。

图1:全球大模型演进时间表(不完全统计,截止到2026年5月)

在这本书里,说到“AI”,99%的时候指的是LLM和由它驱动的AI Agent。 至于AI家族里其他的成员,比如自动驾驶、人脸识别、围棋AI等等,我们只在对比的时候提到,让你看清楚LLM能做什么、不能做什么。

好,现在你知道我们在聊谁了。接下来,钻进它的脑子。

钻进AI的“脑子”

让我们回到刚才那一瞬间。在你按下发送键之后,你的三十页报告和那句“帮我总结”一起,在AI系统内部变成了什么?

它变成了一串数字。

具体来说,是一个大约两万行的矩阵。你的报告里每一个字、每一个标点,都被切成了被称为 Token (词元)的最小单元。其中中文大约每1.5个字一个Token,英文大约每4个字母(1个单词)一个Token。这些Token又被映射成高维向量,然后喂进一个神经网络(即AI模型)。

接下来发生的事情,和“思考”没有任何关系。

这个神经网络只做一件事:根据前面的所有Token,预测下一个最可能出现的Token。 它不是在“理解”你的报告,不是在“提炼”核心观点,更不是在“判断”哪些内容是重要的。它在做一道极其复杂的数学题:给定过去两万个Token,第两万零一个Token最可能是什么?

然后它把这个预测结果加回上下文,再预测第两万零二个。然后第两万零三个。第两万零四个。

就这样,一个字一个字地,它“生成”了你看到的那三条结论。

现在,关键问题来了:在每一步预测中,这个系统都在“选择”。 它不是在“查找”报告里有什么(AI模型本身没有数据库,没有搜索引擎,也没有任何“事实核对”机制)。它只是在用训练时学到的统计规律,猜一个在当前上下文中“看起来最合理”的下一个词。

大多数时候,这个“看起来最合理”碰巧和事实一致,因为它的训练数据里确实包含了海量人类知识,统计规律足够强。但有时候,“看起来最合理”的东西,碰巧不是真的。而且它自己不知道。

它没有“我是否在编造”的意识。它只有一个概率分布,和一个采样策略。当概率分布不够锐利,也就是多个候选Token的概率接近时,它选哪一个几乎就是随机的。而那个被选中的词,会立刻成为新的“事实”,写进上下文,影响后续的所有预测。

这就是幻觉的根源。不是bug,不是模型“坏了”。它是概率预测系统的结构性特征,就像内燃机必然产生废气一样。大模型拥有丰富的“分布式语义”关联,但缺乏指向真实世界的“指称语义”。它能写出逻辑完美的句子,但无法区分这个句子描述的是事实还是虚构。

你用的那个对话框看起来像聊天,但它背后不是一个在和你对话的人。它是一台概率生成引擎,被包装成了聊天界面的样子。

聊天框,是你用不好AI的最大原因

这是本书要讲的第一个反直觉结论:

你每天都在用聊天框,但这恰恰是你用不好AI的最大原因。

聊天框这个界面太成功了。它让任何人都能“用”AI,不需要编程。但“简单”和“好用”是两回事。

错觉一:它在“听”。 它不在听。它在把你说的话编码成Token,然后做概率预测。

错觉二:它在“想”。 它不在想。当你说“不对,再试一次”,它不会反思哪里错了,它只是在上一次对话历史的基础上,重新做一次概率预测。

错觉三:你问了,它答了,所以问题解决了。 AI的输出天然不可靠,“答了”不等于“答对了”。你用聊天的节奏使用一个不确定性的系统。

三个层次,你在哪一层

绝大多数人只操作第一层。少数人意识到第二层。极少数人走到了第三层。

小白学Prompt(提示词,发送给AI的指令或提问),高手搭Context(上下文,提供给AI参考信息),顶级玩家建System(系统,AI所在的体系与框架)。

当前,生成式AI也是发展到了“建System”的阶段,但这不是终点。

这本书不会给你什么 / 会给你什么

- 不会给你100个“万能爆款提示词”

- 不会教你用AI一夜暴富

- 不会逐行讲解某个Agent框架的API

- 不会告诉你“AI正在取代人类”

帮你建立一套理解生成式AI系统的思维框架。不束缚于任何具体模型、具体产品。

读完这本书,你应该能做到三件事:

第一,看懂一个AI产品的设计逻辑。 不管是ChatGPT、Claude、Kimi、千问——你能拆开它的系统提示词、工具链、上下文策略。

第二,诊断一个AI Agent为什么不稳定。 你能定位问题是出在上下文污染、工具误调用、注意力稀释还是评估缺失。

第三,从零设计一个可靠的AI Agent系统。 你能识破网红AI产品背后的“把戏”,了解AI产品从需求到上线的完整流程。

这本书写给谁 / 怎么读

第一类: 每天用AI但总觉得不顺手。

第二类: 正在做AI产品但总觉得不稳定。

第三类: 想认真做AI应用但不知道从哪开始。

本书前三章是认知地基。第四到七章是工程体系。第八章和小结随时跳读。每一章结尾有自查清单。

这本书的名字叫《为什么你说话AI不爱听》。但你很快会发现,“不爱听”并不是因为你的表达能力有问题。而是因为你一直在用一个“对人说话”的方式,跟一台概率引擎沟通。一旦你理解了这台引擎是如何运转的,你会发现它从来不“不爱听”,它只是用了一种你不了解的语言在“听”。学会这门语言不需要任何技术背景。你需要的只是一点好奇心,和一套对的思维框架。

参考链接

- Ashish Vaswani et al., "Attention Is All You Need", arXiv:1706.03762, 2017. https://arxiv.org/abs/1706.03762

- Andrew Ng, "ChatGPT Prompt Engineering for Developers", DeepLearning.AI. https://www.deeplearning.ai/courses/chatgpt-prompt-eng

- Andrew Ng, "Agentic AI", DeepLearning.AI, 2025. https://www.deeplearning.ai/courses/agentic-ai/ ;中文翻译版 https://github.com/datawhalechina/agentic-ai

《为什么你说话 AI 不爱听》