一个被忽略的常识

如果我让你说出一个“AI”的名字,你脱口而出的多半是 ChatGPT、豆包、Claude、Kimi,或者你手机里那个智能助手。

这很正常。过去三年,“大语言模型”和“生成式AI”铺天盖地,好不热闹。但这不正常的地方在于:很多人开始觉得AI = 聊天“机器人”。

当然,AI肯定不是聊天“机器人”,能聊天的“机器人”也不是“机器人”。

这不是一个词义辨析的游戏。这是一个认知错误:它会影响你对AI能做什么、不能做什么、危险在哪里的全部判断。

当你以为AI就是聊天机器人时:

- 你不会理解为什么自动驾驶也是AI

- 你不会意识到你用手机拍照时的人像虚化、语音输入时的实时转写,这些都是AI

- 你更不会想到,决定一个仓库机器人能不能准确抓取货品的那个系统,和ChatGPT共用同一套底层模型结构

但当你理解了AI的完整版图,你会突然看懂很多事:为什么大语言模型会“说错话”而人脸识别不会“认错人”?为什么能让AI一夜之间爆火的围棋AI敢下人类看不懂的招?为什么自动驾驶撞人比写错文案严重一万倍?

这一章,我们就刨根问底。

AI到底是什么

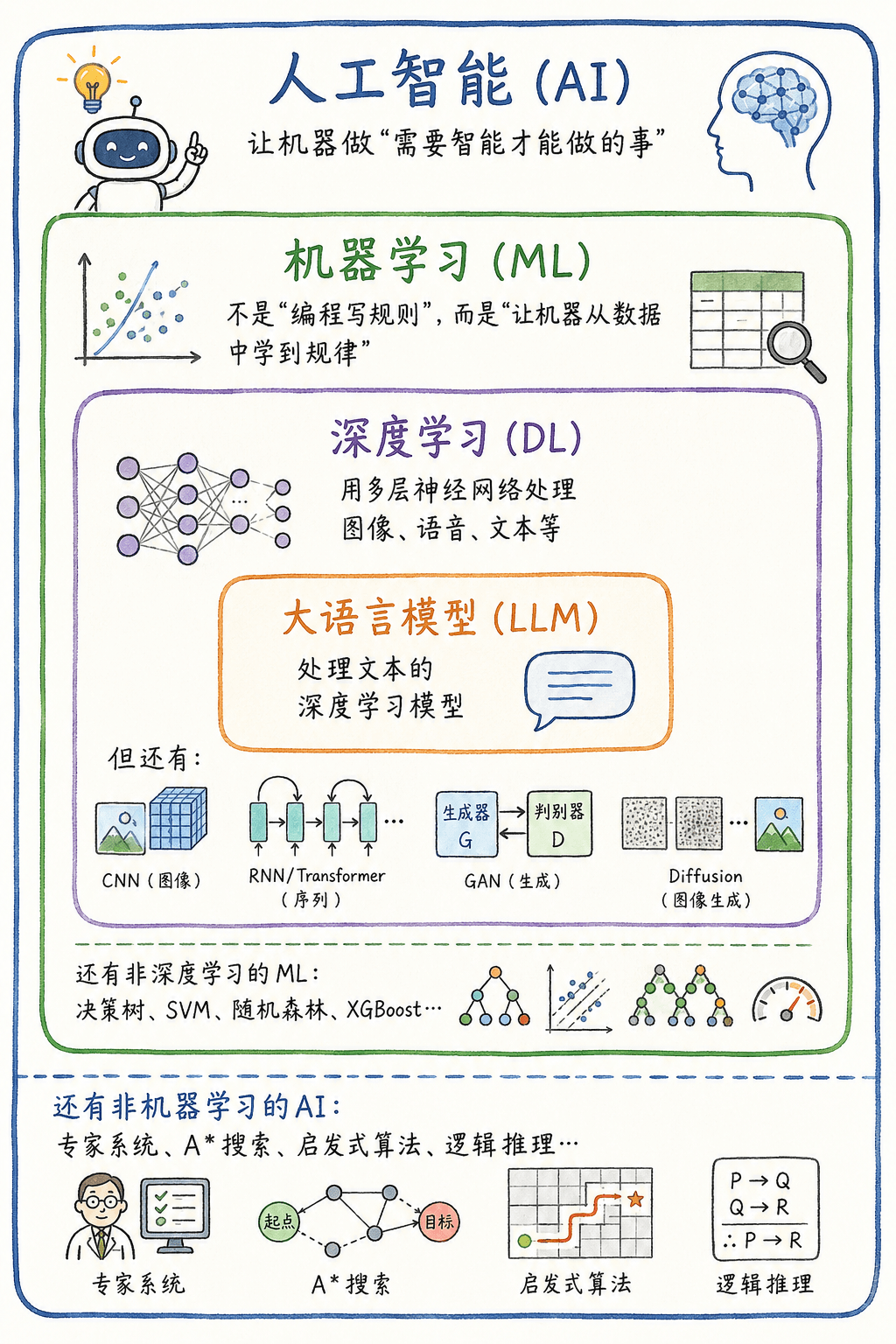

不需要背概念,我们看一张图。

图1:AI的定义与范围

最外层蓝色——人工智能(AI): 一切让机器表现出“智能行为”的技术。下围棋、识别人脸、理解语音、控制机器人走路、给你推荐视频……只要在某个任务上做出了看起来“需要智慧”的结果,都算AI。

第二层绿色——机器学习(ML): AI的一个子集。传统编程是“人写规则,机器执行”(如果是红灯,就要停车)。机器学习是“人给数据,机器自己找规律”(喂给它十万张“红灯”和“非红灯”的照片,神经网络模型自己学会怎么判断)。

第三层紫色——深度学习(DL): 机器学习的一个子集。特点是“层数多”,即用多层神经网络(几十层、上百层、上千层)来提取数据中的深层模式。这层是现代AI的核心引擎。

最内层橙色——大语言模型(LLM): 深度学习的一种特定应用。它专门处理文本序列(后来也扩展到图像、音频等多模态数据)。ChatGPT、豆包都在这一层。

你现在看到很多人在讨论的“AI”,其实只是在说最里面那个小橙圈。

但外面那几圈同样重要,甚至在某些领域更重要。

LLM之外,AI还在做什么

我们走马观花,看几个方向。不是为了让你成为专家,而是让你感受一下“AI”这个词真正的覆盖范围。

图2: 各种AI的区别

计算机视觉(CV)——让机器“会看”

你手机的人脸解锁。医院里CT影像的肿瘤筛查。工厂传送带上自动挑出残次品。自动驾驶汽车识别行人、路标和车道线。

这些系统的底层技术是卷积神经网络(CNN)及其后代,它们从像素中提取边缘、形状、局部特征、全局语义,一层一层向上抽象。2012年,一个叫AlexNet的模型在大规模图像识别比赛中把错误率从26

现在你每天用的“拍照搜题”“拍照识花”“视频美颜”背后都有CV。但大部分人在用这些功能时不会说“我在用AI”。

语音技术(ASR/TTS)——让机器“会听会说”

语音识别(ASR)和语音合成(TTS)合在一起,是你和智能音箱、车载助手、手机语音输入交互的基础,它让你与豆包直接对话。

早在深度学习爆发前,语音识别就有一套成熟的统计方法(隐马尔可夫模型)。深度学习进来后,准确率直接跳了一个台阶,从“勉强能听懂”变成“比人还准”。2016年,微软的语音识别系统在某个测试集上达到了人类水平。现在你的手机能实时把你说的话转成文字,延迟不到200毫秒。

强化学习(RL)——让机器“决策”

和前面两种不同,强化学习不是“看数据”或“听声音”,而是“在环境里试错”。

2016年,AlphaGo赢了李世石,“AI”这个概念一炮而红。它怎么做到的?不是背了人类棋谱,是和自己下了几千万盘棋,自己琢磨出了“走哪步赢面大”。2017年,AlphaZero更极端,它完全不看人类棋谱,从零开始自学围棋、国际象棋和将棋,超越几乎所有人类和AI。

强化学习的逻辑是:做对了给奖励,做错了给惩罚,让系统自己在无数次试错中找到最优策略。这套逻辑不只用于下棋,ChatGPT刚问世时在后期训练中使用的RLHF(人类反馈强化学习),本质上就是把“人类偏好”当成奖励信号,让模型学会“怎么回答更让人满意”,这里其实也给用户觉得“AI变笨”埋下了隐患。

顺便说一句,RL中也有一个概念叫Agent,但它与我们后面说的大模型驱动的AI Agent不同。本书所说的Agent就是AI Agent。

具身智能(EI)——让机器“动手”

这是目前AI最热的前沿之一。它回答一个问题:如果AI有了身体,会怎样?

一个仓库里的机械臂,要从杂乱的料箱里抓取特定形状的零件。它的“脑子”是一套视觉+规划+控制的深度学习系统,它的“身体”是电机、传感器和夹爪。这比纯文本生成难得多,错了不是“输出一段错误文字”,而是“撞坏零件”甚至“伤人”。

说白了,就是对“机器人”的又一包装,从机械手(机械臂)到人形机器人,拥有了“大脑”(一般就是动作大模型,VLA)之后就成为了“具身智能”。

具身智能被很多人认为是AI的终极形态:当AI不仅能“说”,还能“做”,那才是真正的“智能体”。

科学AI(AI4S,AI for Science)——让机器“发现”

DeepMind的AlphaFold 2解决了困扰生物学五十年的大问题:根据蛋白质的氨基酸序列预测其三维结构。这不仅是一个AI成果,它改写了药物研发和基础生物学的进程。到2022年,该系统已预测了超过2亿种蛋白质结构(2024年,AlphaFold因此获得诺贝尔化学奖)。

这就是AI在科学领域的威力:它不是“替代科学家”,而是把科学家从“手工分析庞大数据”中解放出来,让他们去问更重要的问题。

LLM为什么成了AI的“代言人”

看到这儿你可能会问:既然AI这么丰富,为什么公众眼里“AI = 聊天机器人”?

因为LLM撞上了一个特殊的东西:语言。

语言是人类最通用、最自然的交互界面。你不会用数学公式和人交流,不会用图像标签和人交流,你用句子。而LLM恰好可以接收句子、输出句子。这意味着任何人不需要会写代码、不需要学过数学,都能直接“使用”它。

这是AI史上第一次,人和机器的交互不需要“翻译”。

对比一下:计算机视觉也需要专业背景才能用(你没法“说话”让一个人脸识别系统工作),强化学习训练一个模型要烧几百万美元算力,一个机器人的硬件成本动辄几十万。

而LLM?打开一个网页,打字,回车。零门槛。

这就是为什么LLM成了AI的“代言人”,不是因为它是AI的全部,而是因为它是AI中唯一一个所有人都能直接触碰到的形态。

这也意味着一个巨大的认知风险:你最容易接触到的那个AI,恰恰是AI家族里最“擅长表演”的一个。 它能流畅地说话,不代表它能准确地思考。它能自信地输出结论,不代表它真正“知道”那个结论。

这一点,我们下一章会展开。

三个你从此要记住的概念

在结束这一章之前,有三个概念需要记住。

Token——AI的“字”

你说话的时候,AI不是“听”,是把你的话切成一小块一小块的符号单元。这个单元就是Token。

- 中文大约1.5个字一个Token:“人工智能”约等于2个Token

- 英文大约4个字母或1个单词一个Token:“artificial”约等于2.5个Token

- 标点符号、换行、空格也可能各占一个Token

为什么要切分?因为大模型的底层(神经网络)只能处理数字,不能处理文字。Tokenizer(分词器)做的就是“把人类文字映射成数字”这件事。

更重要的是:Token不仅决定了AI“读”你的方式,也决定了AI“写”给你的成本。 每次你和AI对话,你输入的内容和你收到的内容,都按Token计费(如果你用付费版的话)。

所以你会看到“中文对话可能比英文对话贵”,就是因为有些AI对话产品会先将中文翻译成英文,翻译的过程是额外的开销。而国产大模型(如DeepSeek)会直接使用中文字词作为Token单位,没有翻译这一步,因此在中文对话场景下,不仅成本更低,而且速度更快、语义保留更完整。相比之下,依赖翻译路径的模型,除了多一层Token开销,还可能因为翻译误差丢失原意,尤其是中文里的成语、俗语、双关语。

上下文窗口——AI的“短期记忆”

AI能“记住”多少对话?取决于它的上下文窗口,也就是前面说到用于计算概率的输入条件。

你可以把上下文窗口想象成一个黑板。你和AI的每一次对话,都写在这个黑板上。黑板的大小有限,可能是32K Token(大约2-3万字中文),也可能是200K Token(大约15万字中文)。

当黑板写满了,最前面的内容就会被擦掉。所以:

- 如果你和AI聊了很久,它“忘了”开头你说过的话,不是不尊重你,是黑板满了

- 如果你把一整本书扔进去,AI可能“没看到”中间的某段,因为那段被挤出窗口了

- 上下文窗口的位置也很重要,因为通常越靠近首尾的内容,AI“注意”得越多

推理——AI的“思考”

当我们说AI“推理”时,我们在说的不是人类的逻辑思考。

AI的“推理”是:把输入Token跑一遍神经网络,在每一层做矩阵乘法+非线性变换,最终输出一个新的Token。这个Token被加回输入,再跑一遍。如此循环,直到生成结束。

所以AI的“推理”更像是一台巨大的函数机器:输入一串数字,输出一串数字。只不过这台函数机器有几千亿个参数(可以理解为“旋钮”),旋钮调整得当,它输出的数字序列恰好对应一段有逻辑的话。

但这不意味着它“理解”了逻辑。它只是在大规模训练中学到了“当人们讨论逻辑时,他们通常这样说话”。

本章小结

AI是一个巨大的家族。大语言模型只是这个家族里最能说会道的那个孩子,它因为“语言”这个通用界面,成了全家的门面,但这不意味着它就是全家。

计算机视觉、语音技术、强化学习、具身智能、科学AI……它们和LLM共享一些底层技术(都在深度学习这个大框架下),但各自解决完全不同的问题。

认清这个格局的价值在于:

- 你不会高估LLM。 它能写论文不代表它能写很好。

- 你不会低估LLM。 当LLM搭配上工具、记忆和验证(后面几章会讲),它可以从“只会说话”变成“会做事”,甚至做的比人还好。

- 你不会把“AI”这个词用成一个模糊的黑箱。 下次有人说“AI很危险”,你可以追问:你具体说的是哪种AI?

自查清单

在进入下一章之前,检查一下:

- 我能说出AI、机器学习、深度学习、大语言模型这四个概念的包含关系

- 我能举出至少三个“非LLM的AI应用”(比如:人脸识别、语音转文字、围棋AI、蛋白质预测)

- 我理解为什么LLM成了AI的代言人(语言是通用界面+零使用门槛)

- 我能用一句话解释Token是什么

- 我理解LLM为什么会遗忘

- 我知道LLM实际上是计算概率

参考链接

- Alex Krizhevsky, Ilya Sutskever & Geoffrey Hinton, "ImageNet Classification with Deep Convolutional Neural Networks", NeurIPS 2012. https://papers.nips.cc/paper/4824-imagenet-classification-with-deep-convolutional-neural-networks

- Alec Radford et al., "Improving Language Understanding by Generative Pre-Training", OpenAI, 2018.

- OpenAI, "GPT-4 Technical Report", arXiv:2303.08774, 2023. https://arxiv.org/abs/2303.08774

- AlphaFold 2 获2024年诺贝尔化学奖, https://www.nobelprize.org/prizes/chemistry/2024/press-release/

- 机器学习(周志华), 清华大学出版社

- 动手学深度学习(李沐等), 人民邮电出版社, https://zh.d2l.ai/

理解了AI的版图,下一个问题是:既然LLM能说会道,为什么它总是曲解你的意思?我们要钻进概率引擎里面去看一看。

《为什么你说话 AI 不爱听》